GPT4-Turbo に匹敵するパフォーマンスを実現するDeepseek-coder-v2でフリーでサクサク動くAIコーディング環境を構築する。

GPT4-Turbo に匹敵するパフォーマンスを実現するDeepseek-coder-v2でフリーでサクサク動くAIコーディング環境を構築する。

※本記事は2025年2月時点の生成AI(2025年版 ChatGPT/GPT-4系)を用いて作成した文章を、ほぼ修正せず公開したものです。 当時のAI出力を技術記録としてそのまま掲載しています。

目次

はじめに

DeepSeek Coder v2を使用して、無料で高速なAIコーディング環境を構築できます。

GPT-4 Turbo相当の性能を持つAIを無制限に利用可能です。

VS Codeと連携し、ローカル環境でコード補完や修正をスムーズに実行することが可能です。

制限なしで利用でき、ChatGPTの無料版の制限に悩まされることがなくなります。

環境

本記事ではリモートPCとしてUbuntuサーバーを使用します。

リモート用のパソコン

| 項目 | 説明 |

|---|---|

| os | Windows 11 |

| cpu | 4コア |

| RAM | 16G |

| disk | 1T |

| GPU | no |

Ubuntuサーバーの構成

| 項目 | 説明 |

|---|---|

| os | Ubuntu 24.04.1 LTS (GNU/Linux 6.8.0-51-generic x86_64) |

| cpu | 6コア / 12スレッド |

| RAM | 32G |

| disk | 2T |

| disk2 | 1T |

| GPU | no |

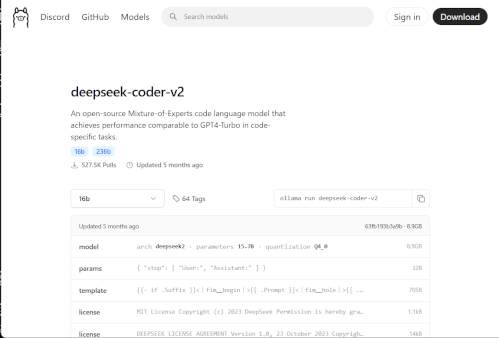

DeepSeek-Coder-v2とは

DeepSeek Coderは、オープンソースのLLMで、GPT-4 Turbo相当の性能を持つAIモデルです。

DeepSeek Coder v2(16B)は、コード補完、デバッグ支援、コード生成が可能です。

Python、C++、Node.js、Dart、JavaScript、PHP

多数の言語に対応しています。

ローカルで動作しするため、外部へのインターネット接続なしで使用可能です。

また、クラウドサーバーを使わない為、セキュリティも高いです。

ライセンス

DeepSeek Coderはオープンソースのライセンスの下で提供されているため、

商用利用も可能です。

詳しくは、ChatGPTに聞いてみてください。

丁寧に教えてくれると思います。

Ollama 環境を構築

Ollamaは、ローカル環境でAIモデルを簡単に実行できるフレームワークです。

Ollamaのインストール

Ubuntuサーバーを使っているため、以下のコマンドを実行してOllamaをインストールします。

curl -fsSL https://ollama.com/install.sh | shDeepSeek Coder v2 16Bをダウンロード

正確にモデル性能が発表されておりませんが、

公式サイトの記載では、GPT-4 Turbo相当の性能であるようです。

モデルが8.9GBのサイズため、ダウンロードに時間がかかります。

また、16Bのモデルは、CPUのRAMが16GB以上必要です。

ollama pull deepseek-coder-v2:16bモデルを実行

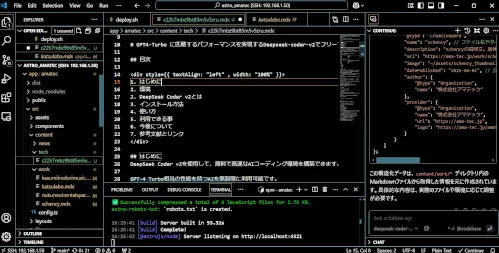

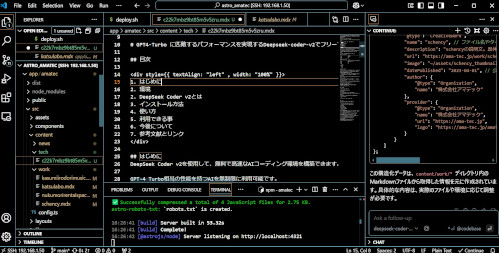

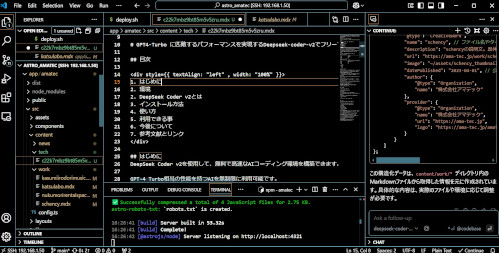

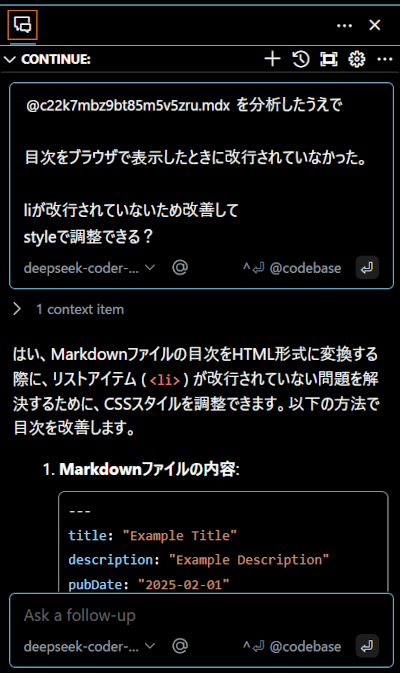

ollama run deepseek-coder-v2:16bVSCodeでのContinue.devの設定方法

Continue拡張機能

Continueは、VS CodeでAI補完を行うための拡張機能です。

他にも、CatGPTやTabNineなどの拡張機能もありますが、

Continueは最も高性能な拡張機能です。

インストール

VS Codeの拡張機能マーケットプレイスでContinueを検索し、

インストールします。

settings.jsonに以下を追加

{

"continue.server": "http://localhost:11434"

}使用方法

下記は一例ですが、ChatGPTのような使い方ができます。

・コード補完

・コードを入力すると、自動的に補完候補が表示される

・コメントを入力すると、コードの修正提案が表示される

・デバッグ支援

・エラーの詳細解析

・最適な修正方法の提案

・テストコードを自動生成

・コードの品質向上

一番のおすすめポイント

現在のプロジェクトを分析した上で、最適な修正方法を提案してくれる点です。

これにより、開発効率が大幅に向上します。

チームでの開発において、コードの品質を一定に保つことができます。

今後について

弊社で使用している開発サーバーは、GPUを搭載しておりません。

そのため、今後はGPUを購入し、よりレスポンスの向上が期待できます。

モデルによっては、RAMの容量が足りない場合もあります。

そのため、RAMの容量を増やすことも今後の課題です。

参考文献とリンク

追記(2026年3月)

本記事は、2025年2月当時のChatGPTを活用して作成した文章を、ほぼ修正せずに公開したものです。

当時は、生成AIを用いて記事を作成し、そのまま公開するスタイルはまだ一般的とは言えず、増加傾向にある過渡期でした。2025年2月時点の日本語圏において、AI生成コンテンツをそのまま公開している事例は推定で数%〜1割程度と見られ、主に実験的・先行的な活用段階にあったと考えられます。

現在の視点から読み返すと、文章構造の組み立て方や表現の癖、説明の粒度などに、当時の大規模言語モデルの特徴が色濃く表れています。わずか1年足らずの間にも、推論精度・文脈保持能力・専門性の扱い方・文章の自然さは大きく進化しており、AI技術の進展スピードを実感させられます。

本記事内には、

「詳しくは、ChatGPTに聞いてみてください。丁寧に教えてくれると思います。」

という一文があります。 これは当時の生成AIに対する期待感や新奇性を象徴する表現として、あえてそのまま残しています。

技術の進化は、振り返って初めてその変化幅を認識できるものです。 本記事は、2025年時点における生成AI活用の一つの記録として、そのまま保存しています。

(天野)